Representa)on Learning Russ Salakhutdinov Department of - PowerPoint PPT Presentation

Representa)on Learning Russ Salakhutdinov Department of Computer Science Department of Statistics University of Toronto Convolu)nal Deep Models for Image Recogni)on ( Krizhevsky et.

Representa)on ¡Learning ¡ Russ ¡Salakhutdinov ¡ Department of Computer Science � Department of Statistics � University of Toronto ¡

Convolu)nal ¡Deep ¡Models ¡ ¡ for ¡Image ¡Recogni)on ¡ ( Krizhevsky ¡et. ¡al. , NIPS 2012) �

Convolu)nal ¡Deep ¡Models ¡ ¡ for ¡Image ¡Recogni)on ¡ ( Krizhevsky ¡et. ¡al. , NIPS 2012) �

• ¡Deep ¡Learning: ¡Beyond ¡Feedforward ¡ Networks ¡ ¡ • ¡Learning ¡More ¡Structured ¡Models: ¡ Transfer ¡Learning ¡ • ¡Mul)modal ¡Learning ¡

Example: ¡Deep ¡Boltzmann ¡Machines ¡ Low-‑level ¡features: ¡ Edges ¡ Input: ¡Pixels ¡ Image ¡ (Salakhutdinov & Hinton, AIStats 2009, Neural Computation 2012) �

Example: ¡Deep ¡Boltzmann ¡Machines ¡ Higher-‑level ¡features: ¡ • ¡ Learn ¡hierarchies ¡of ¡nonlinear ¡features. ¡ Combina)on ¡of ¡edges ¡ • ¡Unsupervised ¡feature ¡learning ¡ – ¡no ¡need ¡ ¡ ¡ ¡ ¡to ¡rely ¡on ¡human-‑craNed ¡input ¡features. ¡ Low-‑level ¡features: ¡ Edges ¡ Input: ¡Pixels ¡ Image ¡ (Salakhutdinov & Hinton, AIStats 2009, Neural Computation 2012) �

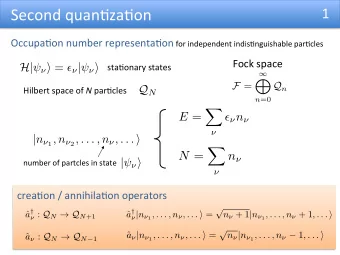

Model ¡Formula)on ¡ h 3 model ¡parameters ¡ W 3 • Dependencies ¡between ¡hidden ¡variables. ¡ h 2 • All ¡connec)ons ¡are ¡undirected. ¡ W 2 • BoPom-‑up ¡and ¡Top-‑down: ¡ h 1 W 1 v Input ¡ Top-‑down ¡ BoPom-‑up ¡ • Unlike ¡many ¡feedforward ¡deep ¡learning ¡architectures. ¡ ¡ ¡

Deep ¡Genera)ve ¡Model ¡ Reuters ¡dataset: ¡804,414 ¡ ¡ newswire ¡stories: ¡ unsupervised ¡ European Community Interbank Markets Monetary/Economic Energy Markets Disasters and Accidents Leading Legal/Judicial Economic Bag ¡of ¡words ¡ Indicators Government Accounts/ Borrowings Earnings

Deep ¡Genera)ve ¡Model ¡ Learned ¡features: ¡``genre’’ ¡ Independence ¡Day ¡ Fahrenheit ¡9/11 ¡ The ¡Day ¡ANer ¡Tomorrow ¡ Bowling ¡for ¡Columbine ¡ Con ¡Air ¡ The ¡People ¡vs. ¡Larry ¡Flynt ¡ Canadian ¡Bacon ¡ Men ¡in ¡Black ¡II ¡ La ¡Dolce ¡Vita ¡ Men ¡in ¡Black ¡ Friday ¡the ¡13th ¡ Scary ¡Movie ¡ The ¡Texas ¡Chainsaw ¡Massacre ¡ Naked ¡Gun ¡ ¡ Children ¡of ¡the ¡Corn ¡ Hot ¡Shots! ¡ Child's ¡Play ¡ American ¡Pie ¡ ¡ The ¡Return ¡of ¡Michael ¡Myers ¡ Police ¡Academy ¡ NeXlix ¡dataset: ¡ ¡ 480,189 ¡users ¡ ¡ 17,770 ¡movies ¡ ¡ Over ¡100 ¡million ¡ra)ngs ¡ State-‑of-‑the-‑art ¡ performance ¡ ¡ on ¡the ¡NeXlix ¡dataset ¡– ¡related ¡to ¡Matrix ¡Factoriza)on. ¡ ¡ (Salakhutdinov et. al. ICML 2007 ) �

Learning ¡Hierarchical ¡Representa)ons ¡ Deep ¡Boltzmann ¡Machines: ¡ ¡ Learning ¡Hierarchical ¡Structure ¡ ¡ in ¡Features: ¡edges, ¡combina)on ¡ ¡ of ¡edges. ¡ ¡ The ¡Shape ¡Boltzmann ¡Machine: ¡a ¡ HallucinaAons ¡in ¡Charles ¡Bonnet ¡ Strong ¡Model ¡of ¡Object ¡Shape ¡ ¡ ¡ Syndrome ¡Induced ¡by ¡Homeostasis: ¡ (Eslami, ¡Heess, ¡Winn, ¡CVPR ¡2012). ¡ ¡ a ¡Deep ¡Boltzmann ¡Machine ¡Model ¡ (Reichert, ¡Series, ¡Storkey, ¡NIPS ¡2012) ¡

• ¡Deep ¡Learning: ¡Beyond ¡Feedforward ¡ Networks ¡ ¡ • ¡Learning ¡More ¡Structured ¡Models: ¡ Transfer ¡Learning ¡ • ¡Mul)modal ¡Learning ¡

Face ¡Recogni)on ¡ Yale ¡B ¡Extended ¡Face ¡Dataset ¡ 4 ¡subsets ¡of ¡increasing ¡illumina)on ¡varia)ons ¡ Due ¡to ¡extreme ¡illumina)on ¡varia)ons, ¡deep ¡models ¡(Deep ¡ Belief ¡Nets) ¡ ¡perform ¡quite ¡poorly ¡on ¡this ¡dataset. ¡ ¡

Deep ¡Lamber)an ¡Model ¡ Consider ¡More ¡Structured ¡Models: ¡undirected ¡+ ¡directed ¡models. ¡ Inferred ¡ Deep ¡ Undirected ¡ Directed ¡ Observed ¡ Image ¡ Combines ¡the ¡elegant ¡proper)es ¡of ¡the ¡Lamber)an ¡model ¡with ¡the ¡ Gaussian ¡DBM ¡model. ¡ (Tang et. Al., ICML 2012, Tang et. al. CVPR 2012) �

Deep ¡Lamber)an ¡Model ¡ Surface ¡ ¡ Image ¡ Light ¡ ¡ albedo ¡ normals ¡ source ¡ Observed ¡ Image ¡ (Tang et. Al., ICML 2012, Tang et. al. CVPR 2012) �

Deep ¡Lamber)an ¡Model ¡ Transfer ¡Learning ¡ Gaussian ¡Deep ¡ ¡ Boltzmann ¡Machine ¡ Albedo ¡DBM: ¡ Pretrained ¡using ¡ Toronto ¡Face ¡Database ¡ Inferred ¡ Surface ¡ ¡ Image ¡ Light ¡ ¡ albedo ¡ normals ¡ source ¡ Observed ¡ Image ¡ Inference: ¡Varia)onal ¡Inference. ¡ Learning: ¡Stochas)c ¡Approxima)on ¡ (Tang et. Al., ICML 2012, Tang et. al. CVPR 2012) �

Face ¡Religh)ng ¡ One ¡Test ¡Image ¡ Inferred ¡ Observed ¡ Face ¡Religh)ng ¡ albedo ¡

Face ¡Religh)ng ¡ One ¡Test ¡Image ¡ What ¡about ¡building ¡ Inferred ¡ Observed ¡ Face ¡Religh)ng ¡ albedo ¡ structured ¡models ¡for ¡ transfer ¡learning? ¡

Supervised ¡Learning ¡ Segway ¡ Motorcycle ¡ Test: ¡ ¡

Transfer ¡Learning ¡ Background ¡Knowledge ¡ Learn ¡to ¡Transfer ¡ Millions ¡of ¡unlabeled ¡images ¡ ¡ Knowledge ¡ Some ¡labeled ¡images ¡ Learn ¡novel ¡concept ¡ from ¡one ¡or ¡few ¡ examples ¡ Bicycle ¡ Dolphin ¡ Elephant ¡ Tractor ¡

Transfer ¡Learning ¡ Background ¡Knowledge ¡ Learn ¡to ¡Transfer ¡ Millions ¡of ¡unlabeled ¡images ¡ ¡ Knowledge ¡ Some ¡labeled ¡images ¡ Learn ¡novel ¡concept ¡ from ¡one ¡or ¡few ¡ examples ¡ Bicycle ¡ Dolphin ¡ Test: ¡ ¡ What ¡is ¡this? ¡ Elephant ¡ Tractor ¡

Learning ¡Category ¡Hierarchy ¡ Learning ¡to ¡share ¡the ¡knowledge ¡across ¡many ¡visual ¡categories. ¡ Deep ¡Boltzmann ¡ … ¡ Machine ¡using ¡ 4 ¡million ¡images ¡ Learned ¡higher-‑level ¡ … ¡ features ¡ Learned ¡low-‑level ¡ (Salakhutdinov et. al., PAMI 2012, Srivastava and generic ¡features ¡ Salakhutdinov, 2013) �

Learning ¡Category ¡Hierarchy ¡ Learning ¡to ¡share ¡the ¡knowledge ¡across ¡many ¡visual ¡categories. ¡ Learned ¡super-‑ Hierarchical ¡ “global” ¡ class ¡hierarchy ¡ structure ¡ “aquaAc ¡ “fruit” ¡ “human” ¡ animal” ¡ dolphin ¡ turtle ¡ shark ¡ ray ¡ apple ¡ orange ¡ pear ¡ girl ¡ baby ¡ man ¡ woman ¡ Deep ¡Boltzmann ¡ … ¡ Machine ¡using ¡ 4 ¡million ¡images ¡ Learned ¡higher-‑level ¡ … ¡ features ¡ Learned ¡low-‑level ¡ generic ¡features ¡ (Salakhutdinov et. al., PAMI 2012) �

Learning ¡from ¡3 ¡Examples ¡ Given ¡only ¡3 ¡Examples ¡ Rocket ¡ Willow ¡Tree ¡ Generated ¡Samples ¡

• ¡Deep ¡Learning: ¡Beyond ¡Feedforward ¡ Networks ¡ ¡ • ¡Learning ¡More ¡Structured ¡Models: ¡ Transfer ¡Learning ¡ • ¡Mul)modal ¡Learning ¡

Shared ¡Concept ¡ “Modality-‑free” ¡representa)on ¡ ¡ “Concept” ¡ sunset, ¡pacific ¡ocean, ¡ baker ¡beach, ¡seashore, ¡ ocean ¡ “Modality-‑full” ¡representa)on ¡ ¡

Challenges ¡-‑ ¡I ¡ ¡ Image ¡ Text ¡ Very ¡different ¡input ¡ representa)ons ¡ sunset, ¡pacific ¡ocean, ¡ baker ¡beach, ¡seashore, ¡ • ¡Images ¡– ¡real-‑valued, ¡dense ¡ ocean ¡ • ¡Text ¡– ¡discrete, ¡sparse ¡ ¡ Dense ¡ Sparse ¡ Difficult ¡to ¡learn ¡ cross-‑modal ¡features ¡ from ¡low-‑level ¡ representa)ons. ¡

Challenges ¡-‑ ¡II ¡ ¡ Image ¡ Text ¡ pentax, ¡k10d, ¡ pentaxda50200, ¡ Noisy ¡and ¡missing ¡data ¡ kangarooisland, ¡sa, ¡ australiansealion ¡ mickikrimmel, ¡ mickipedia, ¡ headshot ¡ < ¡no ¡text> ¡ unseulpixel, ¡ naturey, ¡crap ¡

Mul)modal ¡DBM ¡ Undirected ¡Topic ¡ Gaussian ¡model ¡ Model ¡ 0 ¡ Dense, ¡real-‑valued ¡ Word ¡ 0 ¡ image ¡features ¡ 0 ¡ counts ¡ 1 ¡ 0 ¡ (Srivastava and Salakhutdinov, NIPS 2013) �

Mul)modal ¡DBM ¡ Undirected ¡Topic ¡ Gaussian ¡model ¡ Model ¡ 0 ¡ Dense, ¡real-‑valued ¡ Word ¡ 0 ¡ image ¡features ¡ 0 ¡ counts ¡ 1 ¡ 0 ¡ (Srivastava and Salakhutdinov, NIPS 2013) �

Recommend

More recommend

Explore More Topics

Stay informed with curated content and fresh updates.