Mul$-Modal Bayesian Embeddings for Learning Social Knowledge - PowerPoint PPT Presentation

Mul$-Modal Bayesian Embeddings for Learning Social Knowledge Graphs Zhilin Yang 12 , Jie Tang 1 , William W. Cohen 2 1 Tsinghua University 2 Carnegie Mellon

Mul$-‑Modal ¡Bayesian ¡Embeddings ¡for ¡ Learning ¡Social ¡Knowledge ¡Graphs ¡ Zhilin ¡Yang 12 , ¡Jie ¡Tang 1 , ¡William ¡W. ¡Cohen 2 ¡ 1 Tsinghua ¡University ¡ 2 Carnegie ¡Mellon ¡University ¡

AMiner: ¡academic ¡social ¡network ¡ Research ¡interests ¡

Text-‑Based ¡Approach ¡ List ¡of ¡publica$ons ¡ Research ¡interests ¡ Infer ¡

Text-‑Based ¡Approach ¡ Term ¡Frequency ¡=> ¡“challenging ¡problem” ¡ TF-‑IDF ¡=> ¡“line ¡drawing” ¡

Knowledge-‑Driven ¡ Approach ¡ List ¡of ¡publica$ons ¡ Infer ¡ Research ¡interests ¡ Ar>ficial ¡Intelligence ¡ Machine ¡ Data ¡Mining ¡ Learning ¡ Associa>on ¡ Rules ¡ Clustering ¡ Knowledge ¡bases ¡

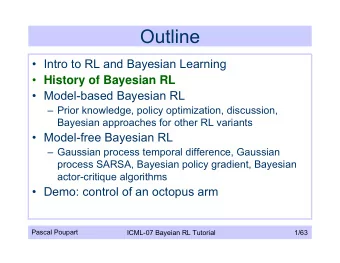

Problem: ¡ Learning ¡Social ¡Knowledge ¡Graphs ¡ Mike ¡ Deep ¡Learning ¡ for ¡NLP ¡ Kevin ¡ Jane ¡ Deep ¡Learning ¡ Natural ¡Language ¡ Processing ¡ Recurrent ¡ Jing ¡ networks ¡for ¡NER ¡

Problem: ¡ Learning ¡Social ¡Knowledge ¡Graphs ¡ Mike ¡ Deep ¡Learning ¡ for ¡NLP ¡ Kevin ¡ Jane ¡ Deep ¡Learning ¡ Natural ¡Language ¡ Processing ¡ Recurrent ¡ Jing ¡ networks ¡for ¡NER ¡ Knowledge ¡base ¡ Social ¡text ¡ Social ¡network ¡structure ¡

Problem: ¡ Learning ¡Social ¡Knowledge ¡Graphs ¡ Mike ¡ Deep ¡Learning ¡ for ¡NLP ¡ Kevin ¡ Jane ¡ Deep ¡Learning ¡ Natural ¡Language ¡ Processing ¡ Recurrent ¡ Jing ¡ networks ¡for ¡NER ¡ Infer ¡a ¡ranked ¡list ¡of ¡concepts ¡ Kevin: ¡Deep ¡Learning, ¡Natural ¡Language ¡Processing ¡ Jing: ¡Recurrent ¡Networks, ¡Named ¡En$ty ¡Recogni$on ¡

Challenges ¡ Mike ¡ Deep ¡Learning ¡ for ¡NLP ¡ Kevin ¡ Jane ¡ Deep ¡Learning ¡ Natural ¡Language ¡ Processing ¡ Recurrent ¡ Jing ¡ networks ¡for ¡NER ¡ Two ¡modali$es ¡– ¡users ¡and ¡concepts ¡ How ¡to ¡leverage ¡informa$on ¡from ¡both ¡modali$es? ¡ How ¡to ¡connect ¡these ¡two ¡modali$es? ¡

Approach ¡ Deep ¡Learning ¡ for ¡NLP ¡ Jane ¡ Kevin ¡ Recurrent ¡ Jing ¡ Deep ¡Learning ¡ networks ¡for ¡NER ¡ Natural ¡Language ¡ Processing ¡ Learn ¡concept ¡embeddings ¡ Learn ¡user ¡embeddings ¡ Model ¡ Social ¡KG ¡

Model ¡ User ¡Embedding ¡ µ r M y λ r τ r f r T θ α µ k z f k M λ k τ k D T Concept ¡Embedding ¡

Gaussian ¡distribu$on ¡ for ¡user ¡embeddings ¡ Align ¡users ¡and ¡ User ¡Embedding ¡ concepts ¡ µ r M y λ r τ r f r T θ α µ k z f k M λ k τ k D T Gaussian ¡distribu$on ¡ Concept ¡Embedding ¡ for ¡concept ¡embeddings ¡

Inference ¡and ¡Learning ¡ µ r M y λ r τ r f r T θ α µ k z f k M λ k τ k D T Collapsed ¡Gibbs ¡sampling ¡ Iterate ¡between: ¡ 1. Sample ¡latent ¡variables ¡

Inference ¡and ¡Learning ¡ µ r M y λ r τ r f r T θ α µ k z f k M λ k τ k D T Collapsed ¡Gibbs ¡sampling ¡ Iterate ¡between: ¡ 1. Sample ¡latent ¡variables ¡ 2. Update ¡parameters ¡

Inference ¡and ¡Learning ¡ µ r M y λ r τ r f r T θ α µ k z f k M λ k τ k D T Collapsed ¡Gibbs ¡sampling ¡ Iterate ¡between: ¡ 1. Sample ¡latent ¡variables ¡ 2. Update ¡parameters ¡ 3. Update ¡embeddings ¡

AMiner ¡Research ¡Interest ¡Dataset ¡ Ø 644,985 ¡researchers ¡ Ø Terms ¡in ¡these ¡researchers’ ¡publica>ons ¡ § Filtered ¡with ¡Wikipedia ¡ Ø Evalua>on ¡ § Homepage ¡matching ¡ • 1,874 ¡researchers ¡ • Using ¡homepages ¡as ¡ground ¡truth ¡ § LinkedIn ¡matching ¡ • 113 ¡researchers ¡ • Using ¡LinkedIn ¡skills ¡as ¡ground ¡truth ¡ Code ¡and ¡data ¡available: ¡ h\ps://github.com/kimiyoung/genvector ¡

Homepage ¡Matching ¡ Using ¡homepages ¡as ¡ground ¡truth. ¡ Method ¡ Precision@5 ¡ GenVector ¡ 78.1003% ¡ GenVector-‑E ¡ 77.8548% ¡ Sys-‑Base ¡ 73.8189% ¡ Author-‑Topic ¡ 74.4397% ¡ NTN ¡ 65.8911% ¡ CountKG ¡ 54.4823% ¡ GenVector ¡ Our ¡model ¡ CountKG ¡ Rank ¡by ¡frequency ¡ GenVector-‑E ¡ Our ¡model ¡w/o ¡embedding ¡update ¡ Author-‑topic ¡ Classic ¡topic ¡models ¡ Sys-‑Base ¡ AMiner ¡baseline: ¡key ¡term ¡extrac>on ¡ NTN ¡ Neural ¡tensor ¡networks ¡

LinkedIn ¡Matching ¡ Using ¡LinkedIn ¡skills ¡as ¡ground ¡truth. ¡ Method ¡ Precision@5 ¡ GenVector ¡ 50.4424% ¡ GenVector-‑E ¡ 49.9145% ¡ Author-‑Topic ¡ 47.6106% ¡ NTN ¡ 42.0512% ¡ CountKG ¡ 46.8376% ¡ GenVector ¡ Our ¡model ¡ CountKG ¡ Rank ¡by ¡frequency ¡ GenVector-‑E ¡ Our ¡model ¡w/o ¡embedding ¡update ¡ Author-‑topic ¡ Classic ¡topic ¡models ¡ NTN ¡ Neural ¡tensor ¡networks ¡

Error ¡Rate ¡of ¡Irrelevant ¡Cases ¡ Manually ¡label ¡terms ¡that ¡are ¡clearly ¡NOT ¡research ¡ interests, ¡e.g., ¡challenging ¡problem. ¡ Method ¡ Error ¡rate ¡ GenVector ¡ 1.2% ¡ Sys-‑Base ¡ 18.8% ¡ Author-‑Topic ¡ 1.6% ¡ NTN ¡ 7.2% ¡ GenVector ¡ Our ¡model ¡ Author-‑topic ¡ Classic ¡topic ¡models ¡ Sys-‑Base ¡ AMiner ¡baseline: ¡key ¡term ¡extrac>on ¡ NTN ¡ Neural ¡tensor ¡networks ¡

Qualita$ve ¡Study: ¡ Top ¡Concepts ¡within ¡Topics ¡ GenVector ¡ Author-‑Topic ¡ Query ¡expansion ¡ Speech ¡recogni>on ¡ Concept ¡mining ¡ Natural ¡language ¡ Language ¡modeling ¡ *Integrated ¡circuits ¡ Informa>on ¡extrac>on ¡ Document ¡retrieval ¡ Knowledge ¡extrac>on ¡ Language ¡models ¡ En>ty ¡linking ¡ Language ¡model ¡ Language ¡models ¡ *Microphone ¡array ¡ Named ¡en>ty ¡recogni>on ¡ Computa>onal ¡linguis>cs ¡ Document ¡clustering ¡ *Semidefinite ¡programming ¡ Latent ¡seman>c ¡indexing ¡ Ac>ve ¡learning ¡

Qualita$ve ¡Study: ¡ Top ¡Concepts ¡within ¡Topics ¡ GenVector ¡ Author-‑Topic ¡ Image ¡processing ¡ Face ¡recogni>on ¡ Face ¡recogni>on ¡ *Food ¡intake ¡ Feature ¡extrac>on ¡ Face ¡detec>on ¡ Computer ¡vision ¡ Image ¡recogni>on ¡ Image ¡segmenta>on ¡ *Atmospheric ¡chemistry ¡ Image ¡analysis ¡ Feature ¡extrac>on ¡ Feature ¡detec>on ¡ Sta>s>cal ¡learning ¡ Digital ¡image ¡processing ¡ Discriminant ¡analysis ¡ Machine ¡learning ¡algorithms ¡ Object ¡tracking ¡ Machine ¡vision ¡ *Human ¡factors ¡

Qualita$ve ¡Study: ¡ Research ¡Interests ¡ GenVector ¡ Sys-‑Base ¡ Feature ¡extrac>on ¡ Face ¡recogni>on ¡ Image ¡segmenta>on ¡ Face ¡image ¡ Image ¡matching ¡ *Novel ¡approach ¡ Image ¡classifica>on ¡ *Line ¡drawing ¡ Face ¡recogni>on ¡ Discriminant ¡analysis ¡

Qualita$ve ¡Study: ¡ Research ¡Interests ¡ GenVector ¡ Sys-‑Base ¡ Unsupervised ¡learning ¡ *Challenging ¡problem ¡ Feature ¡learning ¡ Reinforcement ¡learning ¡ Bayesian ¡networks ¡ *Autonomous ¡helicopter ¡ Reinforcement ¡learning ¡ *Autonomous ¡helicopter ¡flight ¡ Dimensionality ¡reduc>on ¡ Near-‑op>mal ¡planning ¡

Online ¡Test ¡ A/B ¡test ¡with ¡live ¡users ¡ § Mixing ¡the ¡results ¡with ¡Sys-‑Base ¡ Method ¡ Error ¡rate ¡ GenVector ¡ 3.33% ¡ Sys-‑Base ¡ 10.00% ¡

Other ¡Social ¡Networks? ¡ Mike ¡ Deep ¡Learning ¡ for ¡NLP ¡ Kevin ¡ Jane ¡ Deep ¡Learning ¡ Natural ¡Language ¡ Processing ¡ Recurrent ¡ Jing ¡ networks ¡for ¡NER ¡ Knowledge ¡base ¡ Social ¡text ¡ Social ¡network ¡structure ¡

Conclusion ¡ Ø Study ¡a ¡novel ¡problem ¡ § Learning ¡social ¡knowledge ¡graphs ¡ Ø Propose ¡a ¡model ¡ § Mul>-‑modal ¡Bayesian ¡embedding ¡ § Integrate ¡embeddings ¡into ¡graphical ¡models ¡ Ø AMiner ¡research ¡interest ¡dataset ¡ § 644,985 ¡researchers ¡ § Homepage ¡and ¡LinkedIn ¡matching ¡as ¡ ground ¡truth ¡ Ø Online ¡deployment ¡on ¡AMiner ¡

Thanks! ¡ Code ¡and ¡data: ¡ h\ps://github.com/kimiyoung/genvector ¡ ¡

Recommend

More recommend

Explore More Topics

Stay informed with curated content and fresh updates.